Штучний інтелект штампує “медичні” відео: ризики для здоров’я користувачів

Три основні риси ШІ-згенерованих відео про здоров’я

Тайванський центр перевірки фактів (Taiwan FactCheck Center) зауважив, що відео про здоров’я, створені за допомогою ШІ й масово поширені в інтернеті, зазвичай мають три спільні риси: сенсаційні клікбейтні заголовки, вигаданих персонажів і сюжети, а також розпливчасті, неконкретні твердження.

Наприклад, у відео зі твердженням, що «розігрівання залишків рису в мікрохвильовці шкідливе для здоров’я», заголовок попереджає, що охолоджений рис начебто не можна розігрівати в мікрохвильовці, а опис обіцяє навчити глядачів гортувати низькокалорійний рис, здатний знизити рівень цукру в крові, — ця новина дуже ефективно привертає увагу.

Втім, під час детальнішого перегляду виявляється, що на початку оповідач представляється 85‑річним лікарем із 55‑річним стажем, а вже за дві хвилини змінює його на 35 років — ця суперечність дає підстави вважати, що персонаж є вигаданим.

У відео також згадуються численні дослідження — такі як «дослідження Гарвардської школи громадського здоров’я ім. Т. Х. Чана 2022 року», «дослідження Медичного центру Джонса Гопкінса», «дослідження групи професора Ямади з Токійського університету в Японії» та «дослідження Оксфордського університету» — але ці посилання є нечіткими й не містять точних бібліографічних даних. Фактчекери спробували здійснити пошук за різними ключовими словами, але не змогли знайти жодної відповідної публікації.

На YouTube є багато подібних каналів, які завантажують велику кількість відео про здоров’я в тому ж стилі, використовуючи сенсаційні, перебільшені заголовки на кшталт «Вживання цих 3 овочів руйнує ваші суглоби», «Люди поважного віку: їжте ці 8 продуктів перед сном і нарощуйте м’язи, поки спите», «Солона вода — найсильніший ополіскувач для рота» та «Шокуюча таємниця базиліку». Усі ці заголовки створені, щоб зачепити увагу, а перевірка Тайванського центру перевірки фактів показує, що такі ролики містять значну кількість неправдивої інформації.

ШІ‑згенеровані відео про здоров’я стрімко поширюються в мережі й часто використовують перебільшені, сенсаційні формулювання, щоб привернути увагу глядачів (Canva)

ШІ‑згенеровані відео про здоров’я стрімко поширюються в мережі й часто використовують перебільшені, сенсаційні формулювання, щоб привернути увагу глядачів (Canva)

Коли «медичні поради» ШІ підштовхують до ризикованої поведінки

Доцент Інституту інженерії тканин ротової порожнини та біоматеріалів Національного університету Ян-Мін-Чжао-Тун Лін Ю-чен зазначає: у медицині кореляція не дорівнює причинно-наслідковому зв’язку. Коли лікарі чи науковці обговорюють медичні дослідження, вони зазвичай дуже обережні, адже медицина постійно розвивається, і висновки багатьох досліджень залишаються попередніми. Якщо люди в інтернеті стикаються з відео, де лунають категоричні твердження, що суперечать повсякденному досвіду — наприклад, «рисові страви з мікрохвильовки шкідливі для здоров’я» або «вживання баклажанів руйнує суглоби», — існує висока ймовірність, що з таким контентом щось не так. Не варто одразу вірити подібним заявам і тим паче їх поширювати.

Дієтологиня лікарні Taipei Post Хуан Шу-хуей також звернула увагу на «повінь» ШІ‑згенерованих відео про здоров’я. Вона застерігає: ці ролики часто «безмежно перебільшують користь окремого інгредієнта» й використовують «напівправдиві, напівхибні твердження» — типову риторику поширення дезінформації про здоров’я. Глядачам варто бути особливо пильними, коли вони натрапляють на подібний контент.

Доцент Інституту поведінки у сфері здоров’я та громадських наук Національного університету Тайваню Хуан По-яо зазначає, що такого роду ШІ‑згенеровані відео про здоров’я часто надмірно спрощують складні зв’язки між поведінкою та ризиками, пропонуючи надто спрощену обіцянку: «Просто зробіть А — і отримаєте Б».

На його думку, коли дедалі більше людей покладаються на такі «швидкі рішення» замість професійних медичних порад, наслідки можуть варіюватися від неправильного харчування чи самоушкоджувальної поведінки до посилення інформаційної нерівності й незворотної шкоди здоров’ю. Частина людей, щиро вірячи у зміст ШІ‑згенерованих відео, може відкладати звернення по медичну допомогу й зрештою втратити «золотий період» для лікування. Це створює серйозні виклики як для здоров’я окремих людей, так і для системи громадського здоров’я загалом.

Експерти застерігають: якщо дедалі більше людей звертатимуться до «народних засобів» з інтернету або надмірно довірятимуть ШІ‑відео й через це зволікатимуть зі зверненням до лікаря, це негативно позначатиметься і на індивідуальному здоров’ї, і на управлінні системою охорони здоров’я (Canva)

Експерти застерігають: якщо дедалі більше людей звертатимуться до «народних засобів» з інтернету або надмірно довірятимуть ШІ‑відео й через це зволікатимуть зі зверненням до лікаря, це негативно позначатиметься і на індивідуальному здоров’ї, і на управлінні системою охорони здоров’я (Canva)

Коли виробництво відео за допомогою ШІ стає цілою індустрією

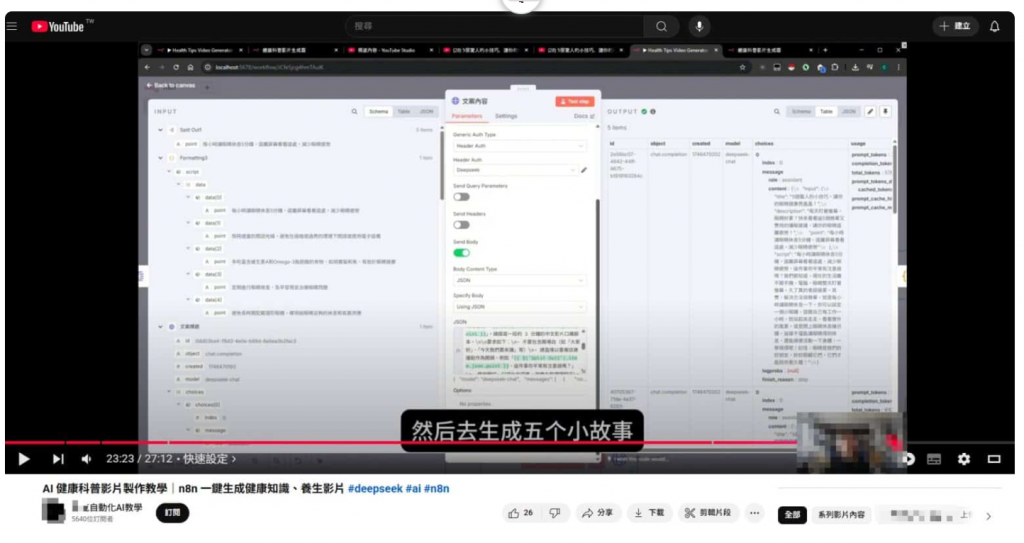

Експерти Національного інституту кібербезпеки Тайваню зазначають, що багато таких роликів, найімовірніше, створюють за допомогою програм на кшталт Jianying: у межах єдиного робочого процесу ШІ генерує текст, візуальні матеріали, монтує відео й додає озвучування. Це дає змогу масово випускати подібні ролики за короткий час і поширювати їх на різних платформах.

Поєднання монтажних застосунків і ШІ‑масштабування майже обнулює вартість виробництва таких відео. Контент часто виглядає правдоподібно й професійно, але містить вигадані та маніпулятивні елементи — так звані «галюцинації» штучного інтелекту. Складність відрізнити правду від неправди є однією з ключових небезпек цієї технології.

Тайванський центр перевірки фактів (Taiwan FactCheck Center) також фіксує: «навчання й допомога користувачам у створенні відео за допомогою ШІ» вже перетворилися на окрему нішу ринку. Багато платних ШІ‑інструментів пропонують різноманітні шаблони й формати відео — озвучування цифровими аватарами, текст‑у‑анімацію, автоматичне збирання відео з картинок і тексту. Користувачеві іноді достатньо ввести одне речення, щоб система згенерувала сценарій, а потім — автоматично створила короткий ШІ‑ролик одним натисканням.

Крім того, деякі користувачі застосовують DeepSeek для подібних «робочих процесів» зі створення відео на медичні теми. Сплативши за членство та заповнивши форму (з темою — наприклад, очі, серце чи легені — і типом відео, наприклад, поради щодо здоров’я чи можливі наслідки), користувач автоматично отримує згенерований заголовок, вступ і повний сценарій. Далі текст озвучує ШІ‑синтез голосу, до нього добираються відповідні зображення та інші матеріали — так автоматично синтезується повноцінне пояснювальне відео про здоров’я.

Цей робочий процес не обмежується темами здоров’я; змінивши запит, його можна легко застосувати до фінансів, порад на щодень, освіти, політики та законодавства, домашніх тварин, історій про привидів тощо. Оскільки створення відео за допомогою штучного інтелекту тепер можна здійснювати без ручного редагування та написання сценарію, бар’єри для виробництва є надзвичайно низькими. Останніми роками такі відео заполонили платформи на кшталт YouTube, а потім поширилися й далі — на особисті сторінки у Facebook та в групи.

Як відео з штучним інтелектом впливають на «емоційний мозок»

Відеоролики, створені за допомогою ШІ на основі вигаданих історій, призначені для активації «емоційного мозку». Доцент Національного університету Ян-Мін-Чжао-Тун Сю Чжі-чун нагадує, що ще під час «інциденту з підміною обличчя за допомогою технології deepfake, пов’язаного з Сяою», що стався у 2021 році, в мережі вже поширювалися навчальні матеріали з підміни обличчя за допомогою deepfake, які поступово перетворилися на цілу галузь. Він каже, що відео, створені штучним інтелектом, які поширюються на різних платформах, в першу чергу призначені для залучення трафіку, тому тема має бути привабливою та оригінальною. Теми змінюються хвилями, щоб підтримувати новизну, і сенсаційні відео про здоров’я є одним із прикладів, які легко привертають увагу громадськості.

Сю Чжі-чун вважає, що у випадку відео про здоров’я люди, які їх створюють і поширюють, не завжди діють зі злого умислу; можливо, вони самі не здатні відрізнити правду від брехні. Оскільки контент, створений штучним інтелектом, генерується на основі людських інструкцій, сама система не несе відповідальності за те, що вона створює. Як наслідок, ці відео про здоров’я, створені штучним інтелектом, часто містять суміш правдоподібних і неправдивих матеріалів, і їм не слід довіряти.

Він також пояснює, що «емоційний мозок» людини зазвичай реагує швидше, ніж «раціональний мозок», тому такі відео часто починаються з вигаданих персонажів, обстановки чи сюжетних ліній, а вже потім переходять до основної тези. Коли емоції глядачів вже зачеплені, вони рідше ставлять під сумнів правдивість тверджень.

Наприклад, такі відео можуть починатися так: «Я — доктор Чжен Шен-мін, мені 85 років, я маю 55 років клінічного досвіду»; «70-річний пан Лін з Тайчжуна дуже ретельно стежить за здоровим харчуванням… через шість місяців його коліна настільки набрякли й боліли, що йому знадобилася палиця для ходьби»; або «Після 12 років прийому ліків від діабету стан 67-річної пані Лін Мей-цяо погіршився, але, змінивши лише спосіб приготування рису протягом п’яти місяців, вона пережила диво…» Ці розповіді покликані крок за кроком занурювати глядачів у вигаданий світ, створений штучним інтелектом.

Хуан По-яо також зазначив, що такі відео про здоров’я, створені штучним інтелектом, часто створюють у людей ілюзію «людської подоби», наділяючи їх «науковою авторитетністю» та пропонуючи «універсальне рішення» складних медичних проблем за дуже короткий час. Це схоже на деяких красномовних псевдоекспертів чи інфлюенсерів, які здаються надійними, але насправді не мають відповідної професійної підготовки.

Це відчуття достовірності є однією з причин, що робить дезінформацію про здоров’я, створену ШІ, переконливою: вона імітує мову експертів, використовує структуровані пояснення та подає себе як вичерпну, навіть коли основні твердження є ненадійними.

Експерти зазначають, що, оскільки емоційний мозок часто реагує швидше, ніж раціональний, глядачі можуть поступово, крок за кроком, поринути у вигадані сценарії, створені відеороликами на основі штучного інтелекту (Canva)

Експерти зазначають, що, оскільки емоційний мозок часто реагує швидше, ніж раціональний, глядачі можуть поступово, крок за кроком, поринути у вигадані сценарії, створені відеороликами на основі штучного інтелекту (Canva)

Коли інтернет переповнений ШІ-контентом, справжніми ліками стають ШІ-грамотність та освіта

Окрім поширення відео про здоров’я, створених штучним інтелектом, дедалі більше людей звертаються до ШІ за «медичними консультаціями», описуючи системі свої симптоми чи занепокоєння в надії отримати відповіді. Сю Чжі-чун нагадує: навіть якщо ШІ здається правим у більшості випадків, «бути правим у більшості випадків не означає бути правим завжди».

За словами Хуана По-яо, «консультації» ШІ можна поділити на два рівні. Перший стосується відносно поширених моделей поведінки, пов’язаних зі здоров’ям, — наприклад, пошуку за допомогою ШІ інформації про фітнес, харчування чи загальні симптоми. Ризики тут нижчі, адже якщо порада виявиться помилковою, організм часто швидко подає відповідні сигнали. Другий рівень значно небезпечніший і стосується психічного здоров’я та медичних рішень. Дослідження й журналістські розслідування показали: іноді ШІ відповідає неадекватно, а подекуди навіть, здавалося б, заохочує до самопошкодження чи самогубства. У таких випадках використання технологій у самодопомозі та «інтимній» комунікації зміщується від установки «я хочу поговорити з людиною» до хибного відчуття «я думаю, що розмовляю з людиною».

Хуан пояснює, що алгоритми штучного інтелекту не створені для того, щоб «піклуватися» про людину; їхня мета — виробляти передбачувані відповіді. ШІ може швидко генерувати велику кількість правдоподібних рекомендацій, однак йому бракує контексту та клінічного мислення, необхідних для обґрунтованих медичних висновків. Коли люди надмірно покладаються на інструменти ШІ, щоб інтерпретувати власні симптоми, вони можуть запізнитися зі зверненням по професійну допомогу й втратити найкращий час для лікування. Це не лише збиває з пантелику щодо індивідуальної поведінки у сфері здоров’я, а й може послабити довіру до системи охорони здоров’я та ускладнити реалізацію політики у сфері громадського здоров’я.

Хуан також зауважує, що на початку цифрової ери поширення інформації про здоров’я залишалося тісно пов’язаним з міжособистісним піклуванням, тоді як в епоху ШІ такі взаємодії дедалі більше нагадують цифрову «виставу». Взаємодія людини й ШІ порушує питання конфіденційності та збору даних: інформація про стан здоров’я та приватні розмови можуть перетворюватися на ресурси даних, які використовують у цілях, далеких від турботи про пацієнта.

Він наголошує, що «подібність до людини» та «ілюзія наукової авторитетності», які створюють ШІ‑згенеровані відео, не є справжніми науковими судженнями чи проявом турботи. Із тим, як ШІ дедалі глибше вкорінюється в повсякденне життя, формування ґрунтовної ШІ‑грамотності стає одним із ключових викликів для сфери охорони здоров’я.

Хсу Чжі-чун додає: контент, створений ШІ, уже став повсюдним, тож громадськість передусім має усвідомити, що значна частина того, з чим вона стикається в інтернеті, могла бути згенерована ШІ. Не слід сприймати все побачене як «чисту монету». У майбутньому частка онлайн-контенту, створеного ШІ, лише зростатиме. У міру розвитку технологій і збільшення обсягів ШІ‑контенту роль людського навчання стає ще важливішою: лише завдяки освіті, постійному навчанню та свідомому використанню ШІ‑інструментів люди зможуть розвинути здатність відрізняти правду від дезінформації.

Перепубліковано з вебсайту TFC у співпраці зі StopFake в межах Ukraine–Taiwan Initiative for Election Information Resilience.